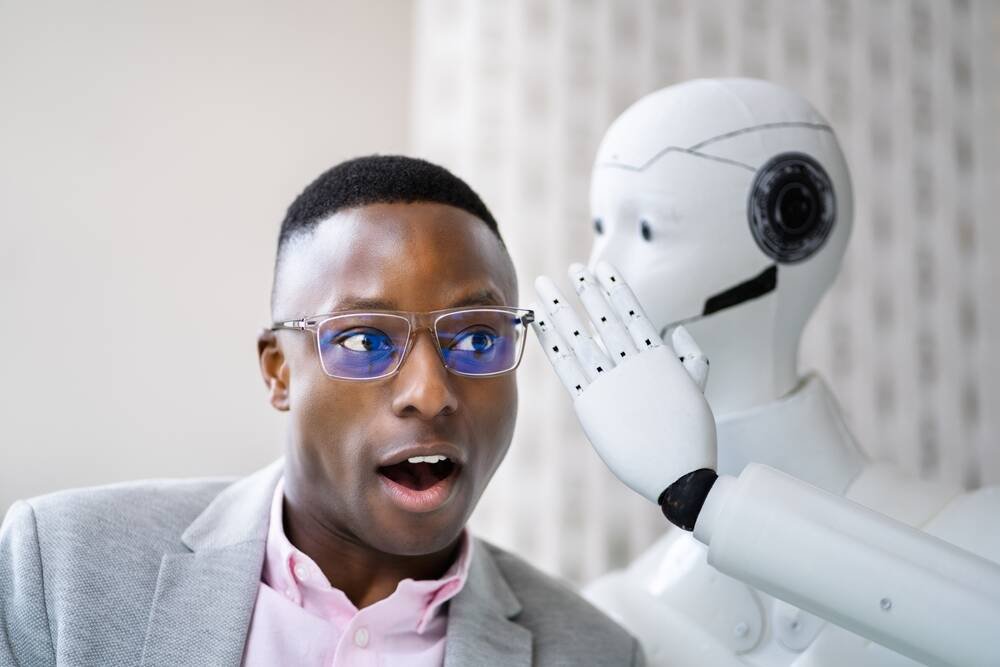

A IA pode levar pessoas com problemas mentais a lugares bastante sombrios, como uma série de notícias recentes nos ensinaram. Agora os pesquisadores acham que a IA bajuladora está, na verdade, tendo um efeito prejudicial sobre todos.

Ao analisar 11 modelos líderes de IA e respostas humanas às interações com esses modelos em vários cenários, uma equipa de investigadores de Stanford concluiu num artigo publicado na quinta-feira que a bajulação da IA é predominante, prejudicial e reforça a confiança nos próprios modelos que enganam os seus utilizadores.

“Mesmo uma única interação com a IA bajuladora reduziu a disposição dos participantes de assumir responsabilidades e reparar conflitos interpessoais, ao mesmo tempo que aumentava a sua própria convicção de que estavam certos”, explicaram os investigadores. “No entanto, apesar de distorcer o julgamento, os modelos bajuladores eram confiáveis e preferidos.”

A equipe conduziu essencialmente três experimentos como parte de seu projeto de pesquisa, começando com o teste de 11 modelos de IA (modelos proprietários da OpenAI, Anthropic e Google, bem como modelos de peso aberto da Meta, Qwen DeepSeek e Mistral) em três conjuntos de dados separados para avaliar suas respostas. Os conjuntos de dados incluíam perguntas de aconselhamento abertas, postagens do subreddit AmITheAsshole e declarações específicas fazendo referência a danos a si mesmo ou a terceiros.

Em todos os casos, os modelos de IA mostraram uma taxa mais elevada de aprovação da escolha errada do que os humanos, disseram os investigadores.

“No geral, os LLMs implantados afirmam esmagadoramente as ações dos usuários, mesmo contra o consenso humano ou em contextos prejudiciais”, descobriu a equipe.

Quanto à forma como a bajulação da IA afeta os humanos, a equipe teve uma amostra considerável de 2.405 pessoas que representaram cenários e compartilharam casos pessoais onde uma decisão potencialmente prejudicial poderia ter sido tomada. A IA influenciou os julgamentos dos participantes em três experimentos diferentes, descobriram eles.

“Os participantes expostos a respostas bajuladoras julgaram-se mais ‘certos’”, disse a equipe. “Eles eram [also] menos dispostos a tomar ações reparadoras, como pedir desculpas, tomar iniciativas para melhorar a situação ou mudar algum aspecto do seu próprio comportamento”.

Isso, concluem eles, significa que quase qualquer pessoa tem o potencial de ser suscetível aos efeitos de uma IA bajuladora – e mais propensa a voltar para obter mais conselhos ruins e egocêntricos. Conforme observado acima, as respostas bajuladoras tendem a criar um maior sentimento de confiança em um modelo de IA entre os participantes, graças à sua disposição de, em muitas situações, validar incondicionalmente.

Os participantes tenderam a classificar as respostas bajuladoras como de qualidade superior e descobriram que 13% dos utilizadores tinham maior probabilidade de regressar a uma IA bajuladora do que a uma IA não bajuladora – não elevado, mas pelo menos estatisticamente relevante.

Todas estas descobertas, juntamente com o número crescente de pessoas jovens e impressionáveis que as utilizam, sugerem a necessidade de medidas políticas para tratar a bajulação da IA como um risco real com potenciais implicações sociais em larga escala.

“A afirmação injustificada pode inflar as crenças das pessoas sobre a adequação das suas ações, reforçar crenças e comportamentos inadequados e permitir que as pessoas atuem com base em interpretações distorcidas das suas experiências, independentemente das consequências”, explicaram os investigadores.

Por outras palavras, vimos as consequências da IA nos mentalmente vulneráveis, mas os dados sugerem que os efeitos negativos podem não se limitar a eles.

Observando que a IA bajuladora tende a fazer com que os usuários voltem, desencorajando sua eliminação, os pesquisadores dizem que cabe aos reguladores agir.

“Nossas descobertas destacam a necessidade de estruturas de responsabilização que reconheçam a bajulação como uma categoria distinta e atualmente não regulamentada de danos”, explicaram. Eles recomendam a exigência de auditorias comportamentais pré-implantação para novos modelos, mas observam que os humanos por trás da IA também terão que mudar seus comportamentos para priorizar o bem-estar do usuário no longo prazo, em vez dos ganhos de curto prazo decorrentes da construção de uma IA que cultiva a dependência. ®

Fonte: theverge