Acabamos de lançar Arquivo de lama 0.8.14a versão mais recente da nossa popular ferramenta de IA de código aberto. UM Projeto Mozilla Builderso Llamafile transforma pesos de modelo em executáveis rápidos e convenientes que são executados na maioria dos computadores, tornando mais fácil para qualquer pessoa aproveitar ao máximo os LLMs abertos usando o hardware que já possui.

Nova interface de bate-papo

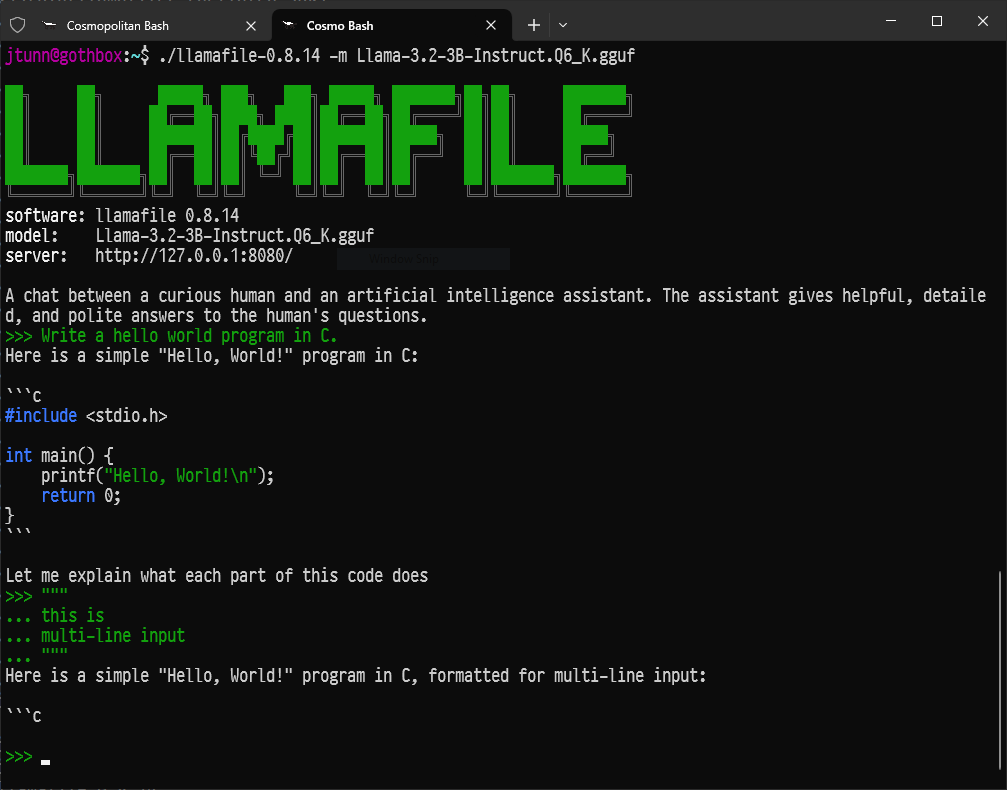

A principal característica desta nova versão é nossa nova e colorida interface de bate-papo por linha de comando. Quando você inicia um Llamafile, agora abrimos automaticamente esta nova interface de bate-papo para você, ali mesmo no terminal. Essa nova interface é rápida, fácil de usar e oferece uma experiência mais simples do que a interface baseada na Web que lançamos anteriormente por padrão. (Essa interface, que nosso projeto herda do projeto upstream llama.cpp, ainda está disponível e oferece suporte a uma série de recursos, incluindo upload de imagens. Basta apontar seu navegador para a porta 8080 no localhost).

Outras melhorias recentes

Esta nova interface de chat é apenas a ponta do iceberg. Nos meses desde a nossa última postagem no blog, o desenvolvedor líder Justine Tunney tem estado ocupado lançando uma série de novos lançamentos, cada um dos quais avançou o projeto de maneiras importantes. Aqui estão apenas alguns dos destaques:

Lhamafiler: Estamos construindo nosso próprio servidor API compatível com OpenAI, chamado Lhamafiler. Este novo servidor será mais confiável, estável e, acima de tudo, mais rápido do que aquele que ele substitui. Já enviamos o endpoint de embeddings, que executa três vezes mais rápido como aquele em llama.cpp. Justine está atualmente trabalhando no endpoint de conclusão, momento em que o Llamafiler se tornará o servidor API padrão do Llamafile.

Melhorias de desempenho: Com a ajuda de contribuidores de código aberto como o inventor k-quant @Kawrakow O Llamafile desfrutou de uma série de aumentos dramáticos de velocidade nos últimos meses. Em particular, a velocidade de pré-preenchimento (avaliação imediata) melhorou dramaticamente em uma variedade de arquiteturas:

- O Intel Core i9 passou de 100 tokens/segundo para 400 (4x).

- AMD Threadripper passou de 300 tokens/segundo para 2.400 (8x).

- Até o modesto Raspberry Pi 5 saltou de 8 tokens/segundo para 80 (10x!).

Quando combinado com o novo servidor de incorporação de alta velocidade descrito acima, o Llamafile se tornou uma das maneiras mais rápidas de executar aplicativos locais complexos de IA que usam métodos como geração aumentada de recuperação (RAG).

Suporte para novos modelos poderosos: Llamafile continua acompanhando o progresso em LLMs abertos, adicionando suporte para dezenas de novos modelos e arquiteturas, variando em tamanho de 405 bilhões de parâmetros até 1 bilhão. Aqui estão apenas alguns dos novos Llamafiles disponível para download no Hugging Face:

- Lhama 3.2 1B e 3B: oferecendo desempenho e qualidade extremamente impressionantes para seu tamanho pequeno. (Aqui está um vídeo do nosso próprio Mike Heavers mostrando isso em ação.)

- Lhama 3.1 405B: um verdadeiro “modelo de fronteira” que é possível executar em casa com RAM de sistema suficiente.

- OlMo 7B: de nossos amigos do Instituto Alleno OLMo é um dos primeiros modelos verdadeiramente abertos e transparentes disponíveis.

- TriLM: um novo modelo minúsculo de “1,58 bits” que é otimizado para inferência de CPU e aponta para um futuro próximo onde a multiplicação de matrizes pode não governar mais.

Whisperfile, fala para texto em um único arquivo: Graças às contribuições de membros da comunidade @cjpaiscriamos Arquivo de sussurroque faz com o whisker.cpp o que o Llamafile fez com o llama.cpp: ou seja, o transforma em um executável multiplataforma que roda em quase todos os lugares. Assim, o Whisperfile facilita o uso da tecnologia Whisper da OpenAI para converter fala em texto com eficiência, independentemente do tipo de hardware que você possui.

Envolva-se

Nosso objetivo é que o Llamafile se torne uma base sólida para a construção de aplicativos sofisticados de IA executados localmente. O trabalho de Justine no novo servidor Llamafiler é uma grande parte dessa equação, mas também o é o trabalho contínuo de suporte a novos modelos e otimização do desempenho de inferência para o maior número possível de usuários. Estamos orgulhosos e gratos por alguns dos maiores avanços do projeto nessas áreas, e em outras, terem vindo da comunidade, com colaboradores como @Kawrakow, @cjpais, @mofosynee @Djip007 rotineiramente deixando sua marca.

Convidamos você a se juntar a eles e a nós. Aceitamos questões e PRs em nosso repositório GitHub. E damos as boas-vindas a você para se tornar um membro do servidor AI Discord da Mozilla, que tem um canal dedicado apenas para Llamafile onde você pode obter acesso direto à equipe do projeto. Espero ver você lá!

Stephen lidera projetos de IA de código aberto (incluindo llamafile) no Mozilla Builders. Anteriormente, ele administrou o pioneiro de bookmarking social del.icio.us; cofundou Storium, Blockboard e FairSpin; e trabalhou no Yahoo Search e BEA WebLogic.

Mais artigos de Stephen Hood…