Este projeto de software acompanha o artigo de pesquisa: Síntese de visão monocular nítida em menos de um segundo

por Lars Mescheder, Wei Dong, Shiwei Li, Xuyang Bai, Marcel Santos, Peiyun Hu, Bruno Lecouat, Mingmin Zhen, Amaël Delaunoy, Tian Fang, Yanghai Tsin, Stephan Richter e Vladlen Koltun.

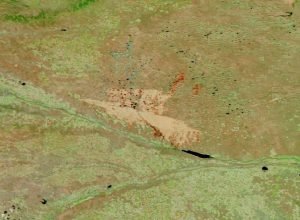

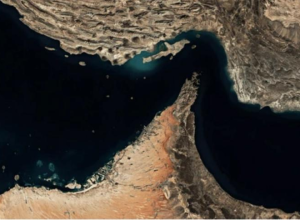

Apresentamos SHARP, uma abordagem para síntese de visão fotorrealista a partir de uma única imagem. Dada uma única fotografia, o SHARP regride os parâmetros de uma representação gaussiana 3D da cena representada. Isso é feito em menos de um segundo em uma GPU padrão por meio de uma única passagem feedforward através de uma rede neural. A representação gaussiana 3D produzida pelo SHARP pode então ser renderizada em tempo real, produzindo imagens fotorrealistas de alta resolução para vistas próximas. A representação é métrica, com escala absoluta, suportando movimentos de câmera métricos. Resultados experimentais demonstram que o SHARP oferece generalização robusta e imediata em conjuntos de dados. Ele estabelece um novo estado da arte em vários conjuntos de dados, reduzindo LPIPS em 25–34% e DISTS em 21–43% em comparação ao melhor modelo anterior, ao mesmo tempo que reduz o tempo de síntese em três ordens de magnitude.

Recomendamos primeiro criar um ambiente python:

conda create -n sharp python=3.13

Depois, você pode instalar o projeto usando

pip install -r requirements.txt

Para testar a instalação, execute

Para executar a previsão:

sharp predict -i /path/to/input/images -o /path/to/output/gaussians

O ponto de verificação do modelo será baixado automaticamente na primeira execução e armazenado em cache localmente em ~/.cache/torch/hub/checkpoints/.

Alternativamente, você pode baixar o modelo diretamente:

wget https://ml-site.cdn-apple.com/models/sharp/sharp_2572gikvuh.pt

Para usar um ponto de verificação baixado manualmente, especifique-o com o -c bandeira:

sharp predict -i /path/to/input/images -o /path/to/output/gaussians -c sharp_2572gikvuh.pt

Os resultados serão splats gaussianos 3D (3DGS) na pasta de saída. O 3DGS .ply os arquivos são compatíveis com vários renderizadores 3DGS públicos. Seguimos a convenção de coordenadas OpenCV (x para a direita, y para baixo, z para frente). O centro da cena 3DGS está aproximadamente em (0, 0, +z). Ao lidar com renderizadores de terceiros, dimensione e gire para centralizar novamente a cena de acordo.

Trajetórias de renderização (somente GPU CUDA)

Além disso, você pode renderizar vídeos com a trajetória da câmera. Embora a previsão gaussiana funcione para todas as CPUs, CUDA e MPS, a renderização de vídeos por meio do --render a opção atualmente requer uma GPU CUDA. O renderizador gsplat demora um pouco para inicializar na primeira inicialização.

sharp predict -i /path/to/input/images -o /path/to/output/gaussians --render

# Or from the intermediate gaussians:

sharp render -i /path/to/output/gaussians -o /path/to/output/renderings

Consulte o artigo para avaliações quantitativas e qualitativas. Além disso, confira esta página de exemplos qualitativos que contém várias comparações de vídeos com trabalhos relacionados.

Se você achar nosso trabalho útil, cite o seguinte artigo:

@inproceedings{Sharp2025:arxiv,

title = {Sharp Monocular View Synthesis in Less Than a Second},

author = {Lars Mescheder and Wei Dong and Shiwei Li and Xuyang Bai and Marcel Santos and Peiyun Hu and Bruno Lecouat and Mingmin Zhen and Ama\"{e}l Delaunoy and Tian Fang and Yanghai Tsin and Stephan R. Richter and Vladlen Koltun},

journal = {arXiv preprint arXiv:2512.10685},

year = {2025},

url = {https://arxiv.org/abs/2512.10685},

}Nossa base de código é construída usando múltiplas contribuições de código aberto, consulte AGRADECIMENTOS para mais detalhes.

Verifique o repositório LICENSE antes de usar o código fornecido e LICENSE_MODEL para os modelos lançados.

Fonte: theverge